De digitale wereld evolueert voortdurend, en een katalysator die dit platform van de andere onderscheidt, is dat wel door gebruikers gegenereerde inhoud. Hoewel bedrijven over de hele wereld hun eigen websites en speciale aanwezigheid op sociale media hebben, vertrouwen gebruikers eerder op de mening van hun medeklanten dan op de woorden van het bedrijf.

Meer dan 4.26 miljard mensen waren actieve gebruikers van sociale media in 2021. Een aantal voorspelde dat het in 6 de grens van 2027 miljard zal overschrijden. De hoeveelheid gegenereerde, vastgelegde, gedeelde en geconsumeerde inhoud op wereldschaal bedroeg in 64.2 2020 zettabytes.

Nu er in een duizelingwekkend tempo nieuwe content wordt gegenereerd en geconsumeerd, is het essentieel geworden dat merken de content die op hun platformen wordt gehost, in de gaten houden. Online platforms moeten een veilige omgeving zijn en blijven voor hun gebruikers.

[Lees ook: Inzicht in geautomatiseerde inhoudsmoderatie]

Wat is inhoudsmoderatie en waarom?

Door gebruikers gegenereerde inhoud drijft sociale mediaplatforms aan, en inhoud modereren verwijst naar het screenen van deze inhoud op ongepaste of aanstootgevende berichten. Zakelijke en sociale mediaplatforms hebben een specifieke standaard voor het monitoren van hun hostinginhoud.

De richtlijnen kunnen alles omvatten van geweld, extremisme, Haattoespraak, naaktheid, inbreuk op het auteursrecht of iets anders dat aanstootgevend is. De geposte inhoud wordt gemarkeerd en verwijderd als deze niet aan de norm voldoet.

Het idee achter inhoudsmoderatie is ervoor te zorgen dat de inhoud in overeenstemming is met de idealen van het merk en de waarden van fatsoen, vertrouwen en veiligheid hooghoudt.

Contentmoderatie is cruciaal voor bedrijven om de zakelijke normen, het merkimago, de reputatie en de geloofwaardigheid te handhaven. Elke seconde maakt de duizelingwekkende hoeveelheid door gebruikers gegenereerde inhoud die op platforms wordt gepost, het voor merken een uitdaging om aanstootgevende en ongepaste inhoud, tekst, video's en afbeeldingen. De strategie voor inhoudsmoderatie helpt merken hun imago te behouden, terwijl gebruikers zichzelf kunnen uiten en aanstootgevende, expliciete en gewelddadige inhoud kunnen afsluiten.

Welke soorten content kun je modereren?

Algoritmen voor het modereren van inhoud hebben over het algemeen betrekking op drie of een combinatie van deze inhoudstypen.

Tekst

De enorme hoeveelheid tekst - van commentaren tot volledige artikelen - die moet worden gemodereerd, is behoorlijk verbluffend. Tekstberichten zijn bijna overal beschikbaar in de vorm van opmerkingen, artikelen, forumberichten, discussies op sociale media en andere berichten.

Algoritmen voor het modereren van tekstinhoud moeten de tekst van verschillende lengtes en stijlen kunnen scannen op ongewenste inhoud. Bovendien kan tekstmoderatie een moeilijke taak zijn vanwege de complexiteit van taal en culturele nuances.

Afbeeldingen

Het modereren van afbeeldingen is veel eenvoudiger dan het modereren van tekst, maar het is essentieel om over de juiste richtlijnen of standaarden te beschikken.

Bovendien, aangezien culturele verschillen een rol kunnen spelen bij het modereren van afbeeldingen, is het van cruciaal belang om de gebruikersgemeenschap op verschillende geografische locaties grondig te begrijpen en er contact mee te maken.

Video's

Het modereren van video-inhoud is erg moeilijk, omdat het modereren van video's tijdrovend kan zijn, in tegenstelling tot tekst of afbeeldingen. De moderator moet de hele video bekijken voordat hij deze geschikt of ongeschikt acht voor consumptie. Zelfs als slechts een paar frames in de video expliciet of storend zijn, dwingt dit de moderator om de volledige inhoud te verwijderen.

Live streaming

Live streaming is misschien wel de meest uitdagende inhoud om te modereren. Het is omdat video en bijbehorende tekstmoderatie gelijktijdig met de streaming moet gebeuren.

Hoe werkt inhoudsmoderatie?

Om aan de slag te gaan met het modereren van de inhoud op uw platform, moet u eerst normen of richtlijnen opstellen die ongepaste inhoud bepalen. Deze richtlijnen helpen moderators inhoud te markeren voor verwijdering.

Definieer het gevoeligheidsniveau of de drempel waar contentmoderators rekening mee moeten houden bij het beoordelen van content. De drempel moet worden bepaald op basis van uw merk, het type bedrijf, de verwachtingen van de gebruiker en de locatie.

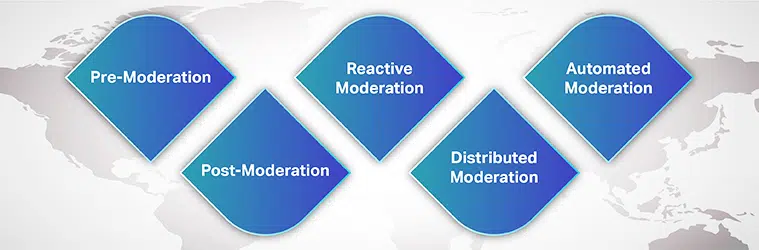

Soorten contentmoderatie

Je kunt uit veel kiezen moderatie processen voor uw merkbehoeften en toestemming van de gebruiker. Sommige ervan zijn:

Pre-moderatie

Voordat de inhoud op uw site wordt weergegeven, staat deze in de wachtrij voor moderatie. Pas nadat de inhoud is beoordeeld en geschikt is bevonden voor consumptie, wordt deze op het platform gepubliceerd. Hoewel dit een veilige methode is om expliciete inhoud te blokkeren, is het tijdrovend.

Post-moderatie

Postmoderatie is de standaardmethode voor contentmoderatie waarbij er een afweging is tussen gebruikersbetrokkenheid en moderatie. Hoewel gebruikers hun inzendingen mogen posten, staat het nog steeds in de wachtrij voor moderatie. Als de inhoud is gemarkeerd, wordt deze beoordeeld en verwijderd. Bedrijven streven naar een kortere beoordelingstijd, zodat ongepaste inhoud niet te lang online blijft staan.

Reactieve moderatie

Met reactieve moderatie wordt de gebruikersgemeenschap aangemoedigd om ongepaste inhoud te markeren die de gemeenschap schendt regels en richtlijnen. Bij deze methode wordt de aandacht van de gemeenschap gevestigd op de inhoud die gemodereerd moet worden. De aanstootgevende inhoud kan echter voor langere tijd op het platform blijven staan.

Gedistribueerde moderatie

Bij een gedistribueerde moderatiemethode kan de online gemeenschap inhoud beoordelen, markeren en verwijderen die zij aanstootgevend en in strijd met de richtlijnen vinden met behulp van een classificatiesysteem.

Geautomatiseerde moderatie

Zoals de naam al doet vermoeden, gebruikt geautomatiseerde moderatie verschillende tools en systemen om woorden of zinsdelen te markeren en inzendingen te weigeren. Het werkt door bepaalde verboden woorden, afbeeldingen en video's eruit te filteren met behulp van machine learning-algoritmen.

Hoewel moderatie op basis van technologie gangbaar wordt, menselijke gematigdheid ter beoordeling kan niet worden genegeerd. Bedrijven gebruiken idealiter een combinatie van geautomatiseerde tools en menselijke moderators, althans voor complexe situaties.

[Lees ook: Casestudy – Contentmoderatie]

Hoe helpt machine learning bij het modereren van inhoud?

Met meer dan 5 miljard mensen die internet gebruiken en meer dan 4 miljard mensen die actief zijn op sociale medianetwerken, is het niet gemakkelijk om versteld te staan van het enorme aantal afbeeldingen, tekst, video's, berichten en berichten dat dagelijks wordt gegenereerd. Deze gigantische inhoud moet op de een of andere manier worden gemodereerd, zodat gebruikers die toegang hebben tot hun sociale-mediasites een prettige en verrijkende ervaring kunnen hebben.

Het modereren van inhoud is ontstaan als de oplossing om inhoud te verwijderen die expliciet, aanstootgevend, beledigend, oplichterij of tegen het merkethos is. Traditioneel vertrouwden bedrijven volledig op menselijke moderators om online door gebruikers gegenereerde inhoud die op hun platforms werd gepubliceerd, te beoordelen. Volledig afhankelijk zijn van menselijke moderators kan het proces echter tijdrovend, kostbaar en inefficiënt maken.

Bedrijven maken nu gebruik van machine learning-algoritmen om inhoud automatisch en efficiënt te modereren. AI-powered inhoudsmoderatie heeft het hele proces efficiënter, sneller, consistenter en kosteneffectiever gemaakt.

Hoewel dit proces de behoefte aan menselijke moderators niet wegneemt, mens-in-the-loop, helpt de bijdrage van menselijke moderators bij het omgaan met complexe problemen. Bovendien begrijpen menselijke moderators taalnuances, culturele verschillen en context beter. Wanneer geautomatiseerde tools worden gebruikt, met hulp van menselijke moderators, vermindert dit de psychologische impact van blootstelling aan activerende inhoud.

Uitdagingen van inhoudsmoderatie

Een andere grote uitdaging als het gaat om het ontwikkelen van een nauwkeurig algoritme voor het modereren van inhoud, is taal. Een betrouwbare toepassing voor het modereren van inhoud moet in staat zijn om meerdere talen te herkennen en culturele nuances, sociale contexten en taaldynamiek te begrijpen.

Aangezien een taal in de loop van de tijd verschillende veranderingen ondergaat, zoals bepaalde woorden die gisteren onschuldig waren, vandaag bekendheid kunnen hebben verworven, moet het ML-model gelijke tred houden met de veranderende wereld. Een naaktschilderij kan bijvoorbeeld expliciet en voyeuristisch zijn of gewoon kunst.

Hoe een stukje inhoud wordt waargenomen of als ongepast wordt beschouwd, hangt af van de context. En het is cruciaal om consistentie en standaarden binnen uw platform te hebben, zodat uw gebruikers uw moderatie-inspanningen kunnen vertrouwen.

Een typische gebruiker probeert altijd mazen in uw richtlijnen te vinden en moderatieregels te omzeilen. Uw ML-algoritme moet echter continu kunnen evolueren met de veranderende tijden.

Ten slotte is het de kwestie van vooringenomenheid. Diversificatie van uw trainingsdatabase en trainingsmodellen om context te detecteren is van cruciaal belang. Hoewel het ontwikkelen van een betrouwbaar algoritme voor het modereren van inhoud misschien een uitdaging lijkt, begint het met het in handen krijgen van hoogwaardige trainingsdatasets.

Externe leveranciers met de juiste expertise en ervaring in het leveren van adequate trainingsdatasets zijn de juiste plaatsen om te beginnen.

Elk bedrijf met een sociale aanwezigheid heeft een cutting-edge nodig oplossing voor inhoudsmoderatie dat helpt bij het opbouwen van klantvertrouwen en een onberispelijke klantervaring. Om de applicatie te bouwen en uw machine learning-model te trainen, hebt u toegang nodig tot een hoogwaardige database zonder vooringenomenheid, afgestemd op de nieuwste taalkunde en marktspecifieke contenttrends.

Met onze jarenlange ervaring in het helpen van bedrijven bij het lanceren van AI-modellen, Shaip biedt uitgebreide gegevensverzamelingssystemen die voorzien in uiteenlopende behoeften op het gebied van inhoudsmoderatie.