Casestudy: inhoudsmoderatie

Meer dan 30 documenten op het web geschrapt en geannoteerd voor inhoudsmoderatie

die ernaar streven om de online ruimte waar we verbinding maken en communiceren te beveiligen.

Naarmate het gebruik van sociale media blijft groeien, is de

probleem van cyberpesten is opgedoken als een

aanzienlijke hindernis voor platforms die ernaar streven

zorgen voor een veilige online ruimte. Een onthutsend

38% van de mensen krijgt hiermee te maken

dagelijks schadelijk gedrag,

benadrukkend de dringende vraag naar inventiviteit

inhoudsmoderatie benadert.

Organisaties vertrouwen tegenwoordig op het gebruik van

kunstmatige intelligentie om het blijvende aan te pakken

proactief probleem van cyberpesten.

Cyberveiligheid:

Facebook's Q4 Community Standards Enforcement Report onthuld - actie op 6.3 miljoen inhoud met pesten en intimidatie, met een proactief detectiepercentage van 49.9%

Onderwijs:

A 2021 studie vond dat 36.5%% van de studenten in de Verenigde Staten tussen de leeftijd van 12 & 17 jaar op een bepaald moment tijdens hun schooltijd met cyberpesten te maken hebben gehad.

Volgens een rapport uit 2020 werd de wereldwijde markt voor oplossingen voor contentmoderatie in 4.07 gewaardeerd op 2019 miljard dollar en zou deze in 11.94 naar verwachting 2027 miljard dollar bereiken, met een CAGR van 14.7%.

Echte wereld oplossing

Gegevens die wereldwijde gesprekken modereren

De klant was bezig met het ontwikkelen van een robuust geautomatiseerd

inhoudsmoderatie Machine Learning

model voor zijn cloudaanbod, waarvoor ze

waren op zoek naar domeinspecifieke leveranciers die

kan hen helpen met nauwkeurige trainingsgegevens.

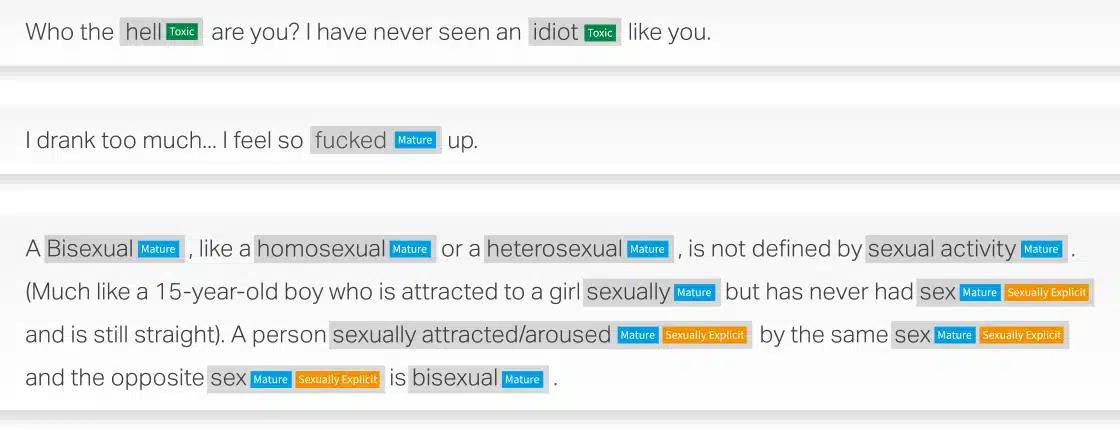

Gebruikmakend van onze uitgebreide kennis op het gebied van natuurlijke taalverwerking (NLP), hielpen we de klant bij het verzamelen, categoriseren en annoteren van meer dan 30,000 documenten in zowel het Engels als het Spaans om geautomatiseerde inhoudsmoderatie te bouwen. Machine Learning-model gesplitst in giftige, volwassen of seksueel expliciete inhoud categorieën.

probleem

- Webscraping van 30,000 documenten in zowel het Spaans als het Engels van geprioriteerde domeinen

- De verzamelde inhoud categoriseren in korte, middellange en lange segmenten

- Labelen van de verzamelde gegevens als giftige, volwassen of seksueel expliciete inhoud

- Zorgen voor annotaties van hoge kwaliteit met een nauwkeurigheid van minimaal 90%.

Oplossing

- Web 30,000 documenten gesloopt voor Spaans en Engels van BFSI, gezondheidszorg, productie en detailhandel. De inhoud werd verder opgesplitst in korte, middellange en lange documenten

- Het labelen van de geclassificeerde inhoud als giftige, volwassen of seksueel expliciete inhoud

- Om 90% kwaliteit te bereiken, implementeerde Shaip een tweeledig kwaliteitscontroleproces:

» Niveau 1: Quality Assurance Check: 100% van de te valideren bestanden.

» Niveau 2: Kritische kwaliteitsanalyse Controle: het CQA-team van Shaips beoordeelt 15%-20% van de retrospectieve monsters.

Resultaat

De trainingsgegevens hielpen bij het bouwen van een geautomatiseerd ML-model voor inhoudsmoderatie dat verschillende resultaten kan opleveren die gunstig zijn voor het behoud van een veiligere online omgeving. Enkele van de belangrijkste uitkomsten zijn:

- Efficiëntie om grote hoeveelheden gegevens te verwerken

- Consistentie bij het waarborgen van uniforme handhaving van moderatiebeleid

- Schaalbaarheid om aan te passen aan groeiende gebruikersbasis en inhoudsvolumes

- Real-time Moderatie kan identificeren &

verwijder mogelijk schadelijke inhoud zodra deze wordt gegenereerd - Kosteneffectiviteit door de afhankelijkheid van menselijke moderatoren te verminderen

Voorbeelden van inhoudsmoderatie

Vertel ons hoe we u kunnen helpen met uw volgende AI-initiatief.