De behoefte aan en de vraag naar door gebruikers gegenereerde gegevens in de huidige dynamische zakenwereld nemen voortdurend toe, waarbij ook contentmoderatie voldoende aandacht krijgt.

Of het nu gaat om posts op sociale media, productrecensies of blogcommentaren, door gebruikers gegenereerde gegevens bieden over het algemeen een boeiendere en authentiekere manier van merkpromotie. Helaas voldoen deze door gebruikers gegenereerde gegevens niet altijd aan de hoogste normen en brengen ze de uitdaging van effectieve inhoudsmoderatie met zich mee.

AI-contentmoderatie zorgt ervoor dat uw content aansluit bij de beoogde doelstellingen van het bedrijf en bevordert een veilige onlineomgeving voor gebruikers. Laten we dus eens kijken naar het diverse landschap van contentmoderatie en de typen en rol ervan onderzoeken bij het optimaliseren van content voor merken.

AI-inhoudsmoderatie: een inzichtelijk overzicht

AI Content moderatie is een effectief digitaal proces dat gebruik maakt van AI-technologieën om door gebruikers gegenereerde inhoud op verschillende digitale platforms te monitoren, filteren en beheren.

Het modereren van inhoud heeft tot doel ervoor te zorgen dat de inhoud die door gebruikers wordt geplaatst, voldoet aan de gemeenschapsnormen, platformrichtlijnen en wettelijke voorschriften.

Contentmoderatie omvat het screenen en analyseren van tekst, afbeeldingen en video's om aandachtspunten te identificeren en aan te pakken.

Het proces van inhoudsmoderatie lost meerdere doelen op, zoals

- Het filteren van ongepaste of schadelijke inhoud

- Minimaliseren van juridische risico’s

- Het bewaken van de merkveiligheid

- Verbetering van de snelheid, consistentie en bedrijfsschaalbaarheid

- Gebruikerservaring verbeteren

Laten we wat dieper ingaan en inhoudsmoderatie levendiger verkennen met de verschillende typen en de rol daarin:

[Lees ook: Inzicht in geautomatiseerde inhoudsmoderatie]

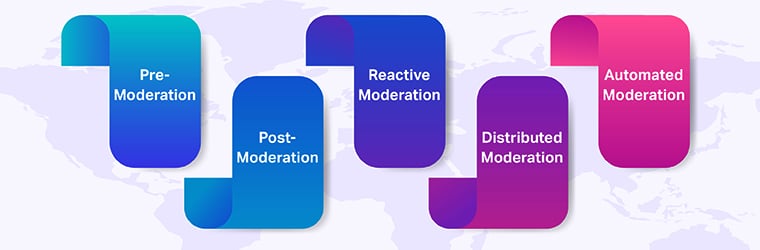

Een kijkje in het contentmoderatietraject: 5 belangrijke fasen

Dit zijn de vijf belangrijkste fasen die de gegevens doorlopen voordat ze de juiste vorm krijgen:

Pre-moderatie

Het gaat om het beoordelen en goedkeuren van inhoud voordat deze op een platform wordt gepubliceerd. Deze methode biedt strakke controle over de inhoud en zorgt ervoor dat alleen inhoud die voldoet aan specifieke zakelijke richtlijnen live gaat. Hoewel deze methode zeer effectief is bij het genereren van een hoge inhoudskwaliteit, kan deze de distributie van de inhoud vertragen omdat er consistente menselijke beoordeling en goedkeuring voor nodig is.

Voorbeeld uit de echte wereld:

Amazone is een populair merk dat inhoudsmoderatie gebruikt om de geschiktheid van de inhoud te garanderen. Omdat Amazon regelmatig duizenden productafbeeldingen en -video's verwerkt, zorgt de Amazon Rekognition-tool ervoor dat de inhoud wordt gevalideerd. Het maakt gebruik van de pre-moderatiemethode om bij meer dan 80% expliciete inhoud te detecteren die de reputatie van het bedrijf zou kunnen schaden.

Post-moderatie

In tegenstelling tot pre-moderatie kunnen gebruikers met post-moderatie in realtime inhoud indienen zonder voorafgaande beoordeling. Dit betekent dat de inhoud onmiddellijk op de liveserver wordt ingezet, maar aan verdere beoordeling wordt onderworpen. Deze aanpak maakt het mogelijk dat inhoud sneller wordt verspreid. Post-moderatie brengt echter ook het risico met zich mee dat er ongepaste of schadelijke inhoud wordt gepubliceerd.

Voorbeeld uit de echte wereld:

YouTube is hiervan een klassiek voorbeeld. Hiermee kunnen gebruikers de inhoud eerst plaatsen en publiceren. Later worden de video's beoordeeld en gerapporteerd vanwege ongepastheid of auteursrechtproblemen.

Reactieve moderatie

Het is een geweldige techniek die door sommige online communities wordt gebruikt om ongepaste inhoud te markeren. Reactieve moderatie wordt over het algemeen gebruikt met de pre- of post-moderatiemethode en is afhankelijk van gebruikersrapporten of geautomatiseerde markeringssystemen om schendingen van de inhoud te identificeren en te beoordelen. De onlinegemeenschappen maken gebruik van meerdere moderators die de nodige acties beoordelen en ondernemen om de geïdentificeerde ongepaste gegevens te verwijderen.

Voorbeeld uit de echte wereld:

Facebook gebruikt de reactieve moderatiemethode om de inhoud op haar platform te screenen. Het stelt zijn gebruikers in staat ongepaste inhoud te markeren en op basis van de collectieve beoordelingen implementeert het verder de vereiste acties. Onlangs heeft Facebook een AI ontwikkeld voor het modereren van inhoud die een succespercentage van meer dan 90% oplevert bij het markeren van inhoud.

Gedistribueerde moderatie

Deze methode is afhankelijk van de deelname van gebruikers om de inhoud te beoordelen en te bepalen of deze geschikt is voor het merk of niet. De gebruikers stemmen over elke voorgestelde keuze en de gemiddelde beoordeling bepaalt welke inhoud wordt geplaatst.

Het enige nadeel van het gebruik van gedistribueerde moderatie is dat het een grote uitdaging is om dit mechanisme in merken te integreren. Het vertrouwen van gebruikers om inhoud te modereren brengt een aantal branding- en juridische risico's met zich mee.

Voorbeeld uit de echte wereld:

Wikipedia maakt gebruik van het distributiemoderatiemechanisme om de nauwkeurigheid en inhoudskwaliteit te behouden. Door verschillende redacteuren en beheerders in te zetten, zorgt team Wikipedia ervoor dat alleen de juiste gegevens naar de website worden geüpload.

Geautomatiseerde moderatie

Het is een eenvoudige maar effectieve techniek die geavanceerde filters gebruikt om woorden uit een lijst te vangen en verder te handelen op basis van vooraf ingestelde regels om de inhoud eruit te filteren. De algoritmen die in het proces worden gebruikt, identificeren patronen die doorgaans potentieel schadelijke inhoud genereren. Deze methode plaatst efficiënt afgestemde inhoud die een grotere betrokkenheid en websiteverkeer kan genereren.

Voorbeeld uit de echte wereld

Geautomatiseerde moderatie wordt door verschillende mensen gebruikt gaming platforms, inclusief PlayStation en Xbox. Deze platforms bevatten geautomatiseerde methoden die spelers detecteren en bestraffen die de spelregels overtreden of cheatcodes gebruiken.

AI-aangedreven gebruiksscenario's bij inhoudsmoderatie

Met inhoudsmoderatie kunnen de volgende soorten gegevens worden verwijderd:

- Expliciete 18+ inhoud: Het is seksueel expliciete inhoud die naaktheid, vulgariteit of seksuele handelingen bevat.

- Agressieve inhoud: Het is inhoud die bedreigingen of intimidatie met zich meebrengt of schadelijk taalgebruik bevat. Het kan ook gaan om het targeten van individuen of groepen en vaak het schenden van gemeenschapsrichtlijnen.

- Inhoud met ongepast taalgebruik: Het is inhoud die aanstootgevend, vulgair of ongepast taalgebruik bevat, zoals scheldwoorden en beledigingen die iemands gevoelens kunnen schaden.

- Misleidende of valse inhoud: Het is de valse informatie die opzettelijk wordt verspreid om het publiek verkeerd te informeren of te manipuleren.

AI Content Moderation zorgt ervoor dat al deze inhoudstypen worden opgehaald en geëlimineerd om nauwkeurigere en betrouwbaardere inhoud te bieden.

Datadiversiteit aanpakken met behulp van contentmoderatie

Inhoud is in verschillende soorten en vormen aanwezig in digitale media. Daarom vereist elk type een gespecialiseerde benadering van moderatie om optimale resultaten te verkrijgen:

[Lees ook: 5 soorten contentmoderatie en hoe u kunt schalen met behulp van AI?]

Tekstgegevens

Voor de tekstgegevens wordt de inhoud gemodereerd met behulp van de NLP-algoritmen. Deze algoritmen gebruiken sentiment analyse om de toon van een bepaalde inhoud te identificeren. Ze analyseren de geschreven inhoud en detecteren eventuele spam of slechte inhoud.

Daarnaast maakt het ook gebruik van Entity Recognition, dat gebruik maakt van de demografische gegevens van bedrijven om de nepheid van inhoud te voorspellen. Op basis van de geïdentificeerde patronen wordt de inhoud gemarkeerd, veilig of onveilig en kan deze verder worden gepost.

Spraakgegevens

Het modereren van spraakinhoud heeft de laatste tijd enorme waarde gewonnen met de opkomst van stemassistenten en spraakgestuurde apparaten. Om de spraakinhoud succesvol te modereren, wordt gebruik gemaakt van een mechanisme dat bekend staat als stemanalyse.

Stemanalyse wordt mogelijk gemaakt door AI en biedt:

- Vertalen van stem naar tekst.

- Sentimentanalyse van de inhoud.

- Interpretatie van de stemtoon.

Afbeeldingsgegevens

Als het gaat om het modereren van beeldinhoud, komen technieken als tekstclassificatie, beeldverwerking en vision-based search goed van pas. Deze krachtige technieken analyseren de afbeeldingen grondig en detecteren eventuele schadelijke inhoud in de afbeelding. De afbeelding wordt verzonden voor publicatie als deze geen schadelijke inhoud bevat of is in het alternatieve geval gemarkeerd.

Videogegevens

Videomoderatie vereist de analyse van audio, videoframes en tekst in video's. Om dit te doen, gebruikt het dezelfde mechanismen als hierboven vermeld voor tekst, beeld en stem. Videomoderatie zorgt ervoor dat ongepaste inhoud snel wordt geïdentificeerd en verwijderd om een veilige online omgeving op te bouwen.

Conclusie

AI-gestuurde contentmoderatie is een krachtig hulpmiddel om de kwaliteit en veiligheid van de content voor verschillende datatypen te behouden. Naarmate de door gebruikers gegenereerde inhoud blijft groeien, moeten platforms zich aanpassen aan nieuwe en effectieve moderatiestrategieën die de geloofwaardigheid en groei van hun bedrijf kunnen vergroten. Je kan Neem contact op met ons Shaip-team als u geïnteresseerd bent in inhoudsmoderatie voor uw bedrijf.