Tegenwoordig verkennen ruim 5.19 miljard mensen het internet. Dat is een groot publiek, nietwaar?

De enorme hoeveelheid inhoud die op internet wordt gegenereerd, is ronduit verbluffend. Van updates op sociale media en blogposts tot door gebruikers gegenereerde opmerkingen en multimedia-uploads: de online wereld is een enorme en dynamische opslagplaats van informatie.

Toch is niet alle inhoud goed. Sommigen kunnen verschillende groepen beledigen vanwege leeftijd, ras, geslacht, nationaliteit of etniciteit. Dergelijke inhoud moet zorgvuldig in de gaten worden gehouden. Dit zorgt voor vrede en harmonie voor iedereen.

Daarom ontstaat er een dringende behoefte aan contentmoderatie. Hoewel de handmatige beoordeling effectief is, zijn er bepaalde beperkingen die we niet kunnen negeren. En dat is waar geautomatiseerde contentmoderatie een effectieve oplossing is. Deze efficiënte methode zorgt voor veilige online ervaringen en beschermt gebruikers tegen mogelijke schade.

In dit stuk zullen we het hebben over de onschatbare voordelen en de diverse typen die beschikbaar zijn in geautomatiseerde moderatietools (vooraf getraind met robuuste datasets).

Inzicht in geautomatiseerde inhoudsmoderatie

Geautomatiseerde contentmoderatie maakt gebruik van technologie om door gebruikers gegenereerde content te overzien en te beheren. In plaats van dat mensen elk bericht scannen, doen algoritmen en machinaal leren het zware werk. Ze identificeren snel schadelijke of ongepaste inhoud. Deze systemen leren van enorme datasets en nemen beslissingen op basis van vastgestelde criteria, zoals vooraf getraind met human-in-the-loop.

Geautomatiseerde methoden voor het modereren van inhoud kunnen zeer efficiënt zijn. Ze werken XNUMX uur per dag en beoordelen onmiddellijk grote inhoudsvolumes. Toch vormen ze ook een aanvulling op menselijke recensenten. Soms is een menselijk tintje essentieel voor de context. Deze combinatie zorgt voor veiligere online ruimtes omdat gebruikers het beste van twee werelden krijgen.

Wilt u een platform dat vrij is van schadelijke inhoud? Geautomatiseerde contentmoderatie is de weg vooruit. We zullen het duidelijker maken als u de typen en voordelen hieronder leest.

[Lees ook: De noodzakelijke gids voor inhoudsmoderatie]

Soorten geautomatiseerde moderatie

Geautomatiseerde contentmoderatie is in de loop der jaren aanzienlijk geëvolueerd. Het omvat nu een spectrum aan technologieën en benaderingen, elk ontworpen om tegemoet te komen aan specifieke behoeften. Hier is een nadere blik op de verschillende typen:

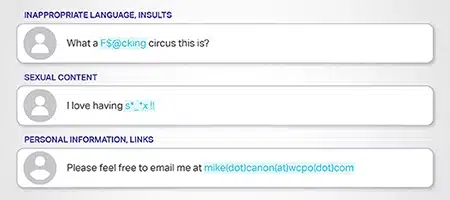

Op trefwoord gebaseerde moderatie

Deze methode werkt op vooraf gedefinieerde lijsten met verboden of gemarkeerde woorden. Wanneer de inhoud deze woorden bevat, weigert het systeem de publicatie ervan of verzendt het ter beoordeling. Platforms kunnen bijvoorbeeld expliciet taalgebruik of termen die verband houden met haatzaaiende uitlatingen blokkeren.

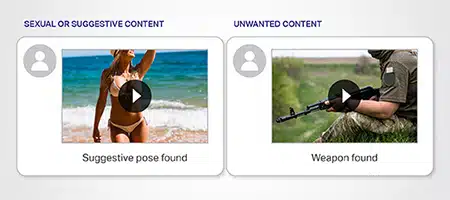

Moderatie van beeldherkenning

Deze methode maakt gebruik van de kracht van machine learning en identificeert ongepaste of gemarkeerde afbeeldingen. Het kan beelden detecteren die geweld, expliciete inhoud of auteursrechtelijk beschermd materiaal promoten. Geavanceerde algoritmen analyseren visuele patronen om ervoor te zorgen dat geen enkel schadelijk beeld onopgemerkt blijft.

Moderatie van videoanalyse

Net als bij beeldherkenning worden bij videoanalyse videocomponenten frame voor frame opgesplitst. Er wordt gecontroleerd op ongepaste beelden, audiosignalen of gemarkeerde inhoud. Het is van onschatbare waarde op platforms zoals YouTube, waar video-inhoud domineert.Sentimentanalyse moderatie

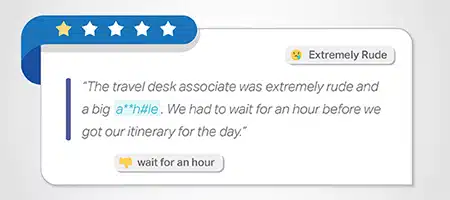

Het begrijpen van het sentiment of de emotie achter de inhoud is van cruciaal belang. Deze methode evalueert de toon van de inhoud en markeert inhoud die overdreven negatief is, haat bevordert of schadelijke gevoelens koestert. Het is vooral handig op forums of platforms die positieve interacties met de gemeenschap bevorderen.

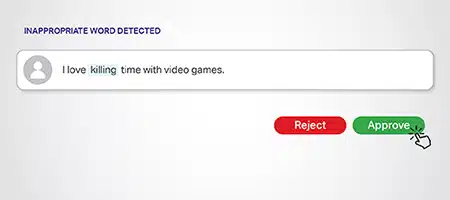

Contextuele moderatie

Inhoud vereist vaak context voor nauwkeurige moderatie. Deze methode evalueert inhoud binnen de omringende context. Het zorgt ervoor dat echte inhoud, zelfs met gemarkeerde woorden, niet ten onrechte wordt geblokkeerd als de algehele context onschadelijk is. In het voorbeeld bevat het het woord 'doden', in de context is het goedaardig, verwijzend naar de onschadelijke activiteit van het spelen van games

Moderatie op basis van gebruikersreputatie

Gebruikers met een geschiedenis van het overtreden van richtlijnen kunnen nader onderzoek vereisen. Dit systeem modereert op basis van de reputatie van de gebruiker. Degenen die al eerder overtredingen hebben begaan, kunnen merken dat hun inhoud strenger wordt beoordeeld dan degenen met een schone lei.

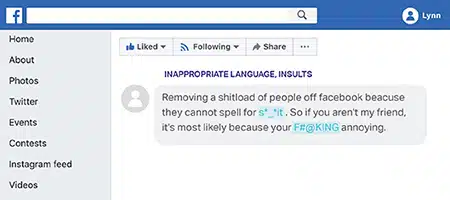

Moderatie van sociale media-monitoring

Gezien de enorme inhoud die op sociale media wordt gegenereerd, monitoren gespecialiseerde tools deze platforms. Ze detecteren potentiële problemen zoals desinformatie, nepnieuws of trollen in realtime. Het helpt bij het creëren van een schonere en veiligere sociale-mediaomgeving.

Voordelen van geautomatiseerde moderatie

Automatisering brengt verschillende voordelen met zich mee. Laten we eens nader kijken naar de voordelen die geautomatiseerde contentmoderatie biedt:

Efficiënte inhoudfiltering

Met de toename van door gebruikers gegenereerde inhoud (UGC) hebben platforms systemen nodig om grote hoeveelheden te doorzoeken. Aanbiedingen voor automatische contentmoderatie efficiënte inhoudfiltering. Het zorgt ervoor dat alleen geschikte materialen het daglicht zien.

Verbeterde digitale veiligheid

Onlineveiligheid is belangrijk om het vertrouwen van gebruikers in het gebruik van internet te vergroten. Automatisering helpt de digitale veiligheid te handhaven door schadelijke inhoud te detecteren. Van haatzaaiende uitlatingen tot online intimidatie, het houdt dergelijke bedreigingen op afstand.

Naleving van de communityrichtlijnen

Communityrichtlijnen handhaven de platformintegriteit. Automatisering zorgt ervoor dat deze regels niet worden overtreden en helpt bij het creëren van harmonieuze onlineruimtes.

Bestrijding van online intimidatie en haatzaaiende uitlatingen

Geautomatiseerde systemen kunnen online intimidatie en haatzaaiende uitlatingen snel identificeren en elimineren. Ze zorgen ervoor dat platforms gastvrij en veilig blijven door schadelijke inhoud te markeren.

Het aanpakken van desinformatie en nepnieuws

In de leeftijd van ongebreidelde desinformatie, automatisering speelt een cruciale rol. Het detecteert en onderdrukt desinformatie/nepnieuws om de waarheid en nauwkeurigheid hoog te houden.

Trollen aanpakken

Trollen kan online dialogen verpesten en betekenisvolle gesprekken doen ontsporen. Geautomatiseerde inhoudsmoderatie spoort deze trollen op en helpt bij het behouden van een positieve omgeving. Stel je een klaslokaal voor. IT fungeert als die voorzichtige kracht die constructieve interacties bevordert en gebruikers een betere ervaring biedt.

Diepgaande analyse

Tekstanalyse gaat verder dan alleen trefwoorddetectie. Het begrijpt de context, promoot echte inhoud en verwijdert schadelijke verhalen. Naast teksten detecteren beeldherkenningstools ook ongepaste beelden. Ze zorgen ervoor dat afbeeldingen overeenkomen met platformstandaarden.

Uitgebreide videomoderatie

Video-inhoud domineert de digitale ruimte omdat mensen van boeiende beelden houden. Automatisering komt tussenbeide om te garanderen dat deze video's aan specifieke normen voldoen. Het doorzoekt enorme hoeveelheden inhoud, detecteert schadelijke elementen en verwijdert deze onmiddellijk.

Conclusie

Geautomatiseerde contentmoderatie biedt zowel voordelen als uitdagingen. Het blinkt uit in het verwijderen van ongeschikte inhoud van digitale platforms. Het heeft echter ook te maken met beperkingen en roept discussies op over censuur en de rol van technologie. In veel gevallen is ook deskundige matiging door mensen vereist in geval van onduidelijkheid.

Platforms moeten duidelijk zijn over moderatieregels. Ze hebben ook systemen nodig waarmee gebruikers besluiten over het verwijderen van inhoud kunnen aanvechten op eerlijkheid en nauwkeurigheid. Met het juiste evenwicht kunnen we eerlijkheid voor onlinegebruikers bereiken en tegelijkertijd hun veiligheid en rechten handhaven.

Deze methode werkt op vooraf gedefinieerde lijsten met verboden of gemarkeerde woorden. Wanneer de inhoud deze woorden bevat, weigert het systeem de publicatie ervan of verzendt het ter beoordeling. Platforms kunnen bijvoorbeeld expliciet taalgebruik of termen die verband houden met haatzaaiende uitlatingen blokkeren.

Deze methode werkt op vooraf gedefinieerde lijsten met verboden of gemarkeerde woorden. Wanneer de inhoud deze woorden bevat, weigert het systeem de publicatie ervan of verzendt het ter beoordeling. Platforms kunnen bijvoorbeeld expliciet taalgebruik of termen die verband houden met haatzaaiende uitlatingen blokkeren. Deze methode maakt gebruik van de kracht van machine learning en identificeert ongepaste of gemarkeerde afbeeldingen. Het kan beelden detecteren die geweld, expliciete inhoud of auteursrechtelijk beschermd materiaal promoten. Geavanceerde algoritmen analyseren visuele patronen om ervoor te zorgen dat geen enkel schadelijk beeld onopgemerkt blijft.

Deze methode maakt gebruik van de kracht van machine learning en identificeert ongepaste of gemarkeerde afbeeldingen. Het kan beelden detecteren die geweld, expliciete inhoud of auteursrechtelijk beschermd materiaal promoten. Geavanceerde algoritmen analyseren visuele patronen om ervoor te zorgen dat geen enkel schadelijk beeld onopgemerkt blijft.

Het begrijpen van het sentiment of de emotie achter de inhoud is van cruciaal belang. Deze methode evalueert de toon van de inhoud en markeert inhoud die overdreven negatief is, haat bevordert of schadelijke gevoelens koestert. Het is vooral handig op forums of platforms die positieve interacties met de gemeenschap bevorderen.

Het begrijpen van het sentiment of de emotie achter de inhoud is van cruciaal belang. Deze methode evalueert de toon van de inhoud en markeert inhoud die overdreven negatief is, haat bevordert of schadelijke gevoelens koestert. Het is vooral handig op forums of platforms die positieve interacties met de gemeenschap bevorderen. Inhoud vereist vaak context voor nauwkeurige moderatie. Deze methode evalueert inhoud binnen de omringende context. Het zorgt ervoor dat echte inhoud, zelfs met gemarkeerde woorden, niet ten onrechte wordt geblokkeerd als de algehele context onschadelijk is. In het voorbeeld bevat het het woord 'doden', in de context is het goedaardig, verwijzend naar de onschadelijke activiteit van het spelen van games

Inhoud vereist vaak context voor nauwkeurige moderatie. Deze methode evalueert inhoud binnen de omringende context. Het zorgt ervoor dat echte inhoud, zelfs met gemarkeerde woorden, niet ten onrechte wordt geblokkeerd als de algehele context onschadelijk is. In het voorbeeld bevat het het woord 'doden', in de context is het goedaardig, verwijzend naar de onschadelijke activiteit van het spelen van games Gebruikers met een geschiedenis van het overtreden van richtlijnen kunnen nader onderzoek vereisen. Dit systeem modereert op basis van de reputatie van de gebruiker. Degenen die al eerder overtredingen hebben begaan, kunnen merken dat hun inhoud strenger wordt beoordeeld dan degenen met een schone lei.

Gebruikers met een geschiedenis van het overtreden van richtlijnen kunnen nader onderzoek vereisen. Dit systeem modereert op basis van de reputatie van de gebruiker. Degenen die al eerder overtredingen hebben begaan, kunnen merken dat hun inhoud strenger wordt beoordeeld dan degenen met een schone lei. Gezien de enorme inhoud die op sociale media wordt gegenereerd, monitoren gespecialiseerde tools deze platforms. Ze detecteren potentiële problemen zoals desinformatie, nepnieuws of trollen in realtime. Het helpt bij het creëren van een schonere en veiligere sociale-mediaomgeving.

Gezien de enorme inhoud die op sociale media wordt gegenereerd, monitoren gespecialiseerde tools deze platforms. Ze detecteren potentiële problemen zoals desinformatie, nepnieuws of trollen in realtime. Het helpt bij het creëren van een schonere en veiligere sociale-mediaomgeving.